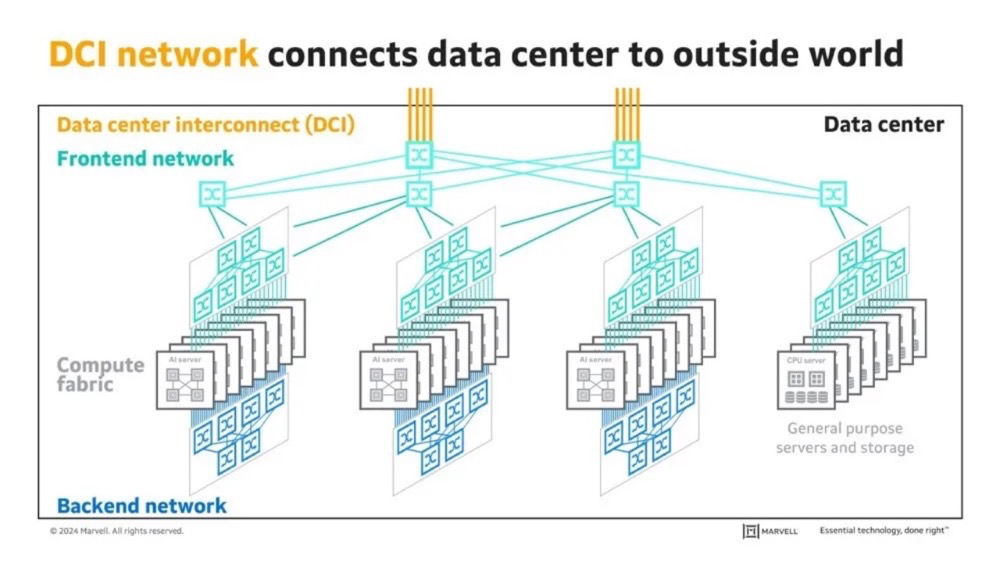

在人工智能工作负载迅猛增长的驱动下,网络行业正处于一场颠覆性变革的浪潮之中。总的来说,人工智能需要四个网络:- 计算Fabric:连接服务器内的 AI 加速器、GPU、CPU 和其他组件。该架构设计用于在短距离内高速运行,通常依赖于使用 PCIe 或 NVLink 等专有接口的铜线。

- 后端网络:使用多层互连的网络交换机和光学模块将上述服务器连接成 AI 集群。网络协议可以是 InfiniBand 或以太网,但两种协议都是通过光学模块运行的。

- 前端网络:将 AI 集群连接到云数据中心,用于存储、交换等。AI 服务器内部的 CPU 负责传输数据,每个 CPU 都有自己的 NIC,连接到自己的光学模块。前端网络使用通过光纤实现的以太网协议。

- 数据中心互连 (DCI) 网络:使用 100 公里或更长的链路将一个数据中心与其他区域内的数据中心连接起来。

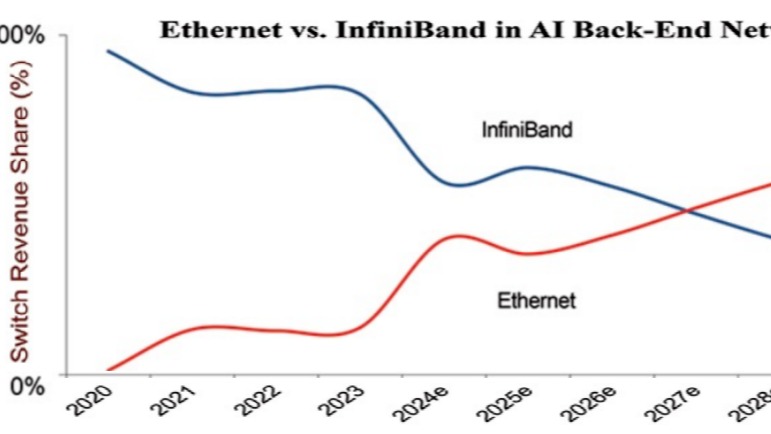

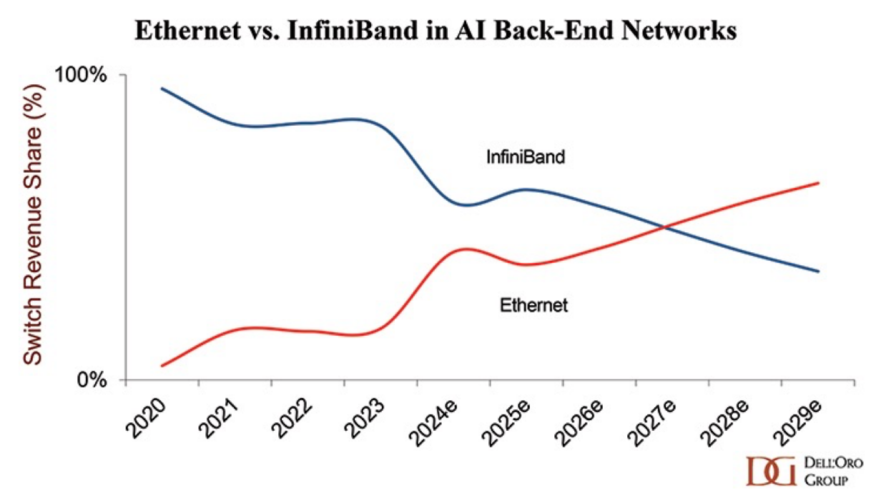

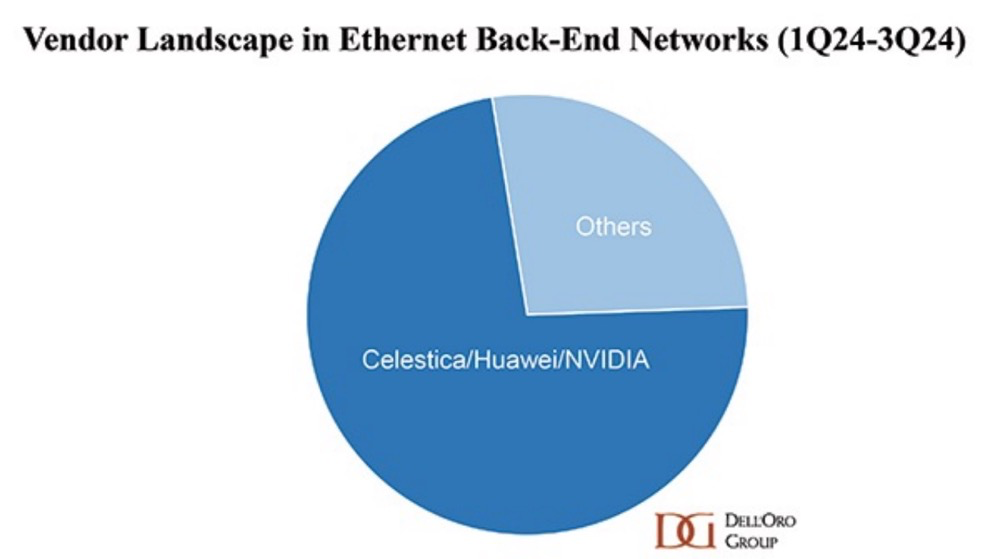

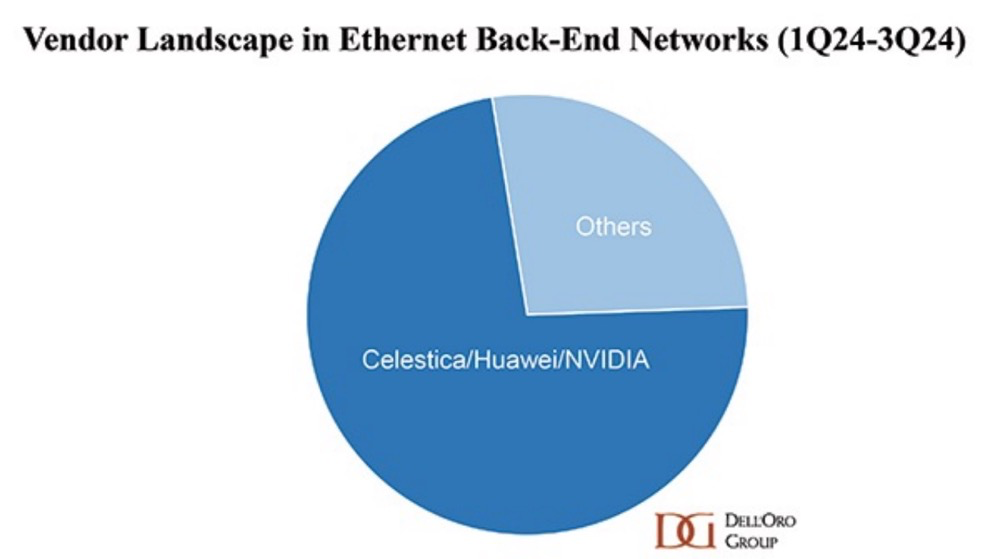

AI服务器通过两层交换光链路(蓝色)在后端网络上连接。前端CPU(绿色)将AI服务器连接到数据中心的其他部分。DCI互连(黄色)将数据中心连接到外部世界。随着大型 AI 集群内加速器数量呈指数级攀升,构建新型 AI 后端网络以实现高效连接,已然成为行业发展的迫切需求。当下,业内对 AI 后端网络的投入达到了前所未有的高度,不过,连接通用服务器的传统前端网络,作为网络架构中不可或缺的基石,在这场变革中依然发挥着关键作用。2029 年,AI 后端网络支出将超过 1000 亿美元,以太网发展势头强劲近期,DeepSeek横空出世,与美国同类模型相比,其所需资源大幅减少,加剧了人们对加速基础设施支出可持续性的担忧。不过业内公司明显乐观的多,谷歌、亚马逊、微软和 Meta 等厂商在1月/2月财报电话会议上公布的最新数据中心资本支出情况表明,它们持续致力于维持高水平的人工智能基础设施资本支出。 Dell'Oro Group 最近发布的《面向人工智能工作负载的人工智能网络》报告显示,预计未来五年(2025-2029 年)内,部署在用于加速服务器的 AI 后端网络中的交换机支出将超过 1000 亿美元。预计到 2025 年,AI 后端网络部署的交换机端口大部分将达到 800 Gbps,到 2027 年将达到 1600 Gbps,到 2030 年将达到 3200 Gbps。在供需利好因素的推动下,以太网发展势头正盛,越来越多的大规模AI 集群将其作为主要架构。加速器种类的日益丰富推动了以太网的应用,包括基于英伟达GPU 的大型集群(如 xAI 的 Colossus)也选择了以太网进行部署。因此,Dell'Oro Group将以太网超越 InfiniBand 的预测时间上调至 2027 年。2025 年,以太网 AI 后端网络市场份额将发生重大变化2024年,以太网市场由Celestica、华为和英伟达主导。Dell'Oro预计,2025 年,Accton、Arista、思科、Juniper、诺基亚等供应商将获得更多的市场份额,重塑市场格局。随着云服务提供商通过在计算端及其配套网络方面实现供应多元化来降低风险,AI后端网络的供应商格局将持续保持高度动态变化。尽管 2024 年面临诸多挑战,但Dell'Oro预计在多种因素的推动下,2025 年及以后,前端网络市场将恢复增长。这些因素包括需要在前端网络中增加容量以支持后端部署,尤其是新建项目。这些额外的前端网络连接部署预计将包括高速(>100 Gbps)连接,从而带来价格溢价。此外,那些可能无需加速服务器,而是在前端网络中运行的推理应用,将进一步推动销售额增长。Dell'Oro Group 预计,未来五年(2025-2029 年)以太网数据中心交换机的销售额可能会超过 1800 亿美元。Accton、Arista、Celestica、思科、瞻博网络、华为、英伟达等供应商将成为这一增长的主要受益者。未来五年内,前端网络将部署超过 1 亿个 800 Gbps 和 1600 Gbps 交换机端口,这些端口将利用市场上即将推出的51.2 Tbps和102.4 Tbps芯片。后端网络的出货量预计至少是这个数字的两倍。随着AI工作负载的不断扩展和多样化,支持它们的前端和后端网络基础设施也必须相应发展。向更高速度以太网的转变以及供应商之间不断变化的竞争格局表明,2025 年可能是以太网数据中心交换市场的关键一年。参考链接:

https://www.delloro.com/traditional-front-end-networks-remain-vital-as-ai-back-end-network-investment-skyrocket/

https://mp.weixin.qq.com/s/z1cehHKPdhrKL0kQpmJbjQ