硅基星轨

作者:黄鑫, 张志佳, 孙平等

来源:《机器人》期刊

编辑:陈萍萍的公主@一点人工一点智能

原文:https://robot.sia.cn/article/doi/10.13973/j.cnki.robot.240176

摘要:传统的路径规划方法在复杂多变的环境中存在明显的局限性,本文首先探讨了这些传统方法的不足,接着引入深度强化学习作为新的解决思路。

全面总结了基于价值函数、基于策略和基于值策略混合3种深度强化学习方法的原理、优缺点以及近年来在各个应用领域上具有代表性的研究成果,并将代表性算法在统一平台上进行测试,给出了实际对比分析。

最后对基于深度强化学习的路径规划技术面临的挑战和研究展望进行了总结。 路径规划对智能体在复杂环境中安全高效移动至关重要。传统的路径规划方法虽然取得了一定的进展,但面临复杂环境时仍存在许多局限性。

路径规划对智能体在复杂环境中安全高效移动至关重要。传统的路径规划方法虽然取得了一定的进展,但面临复杂环境时仍存在许多局限性。

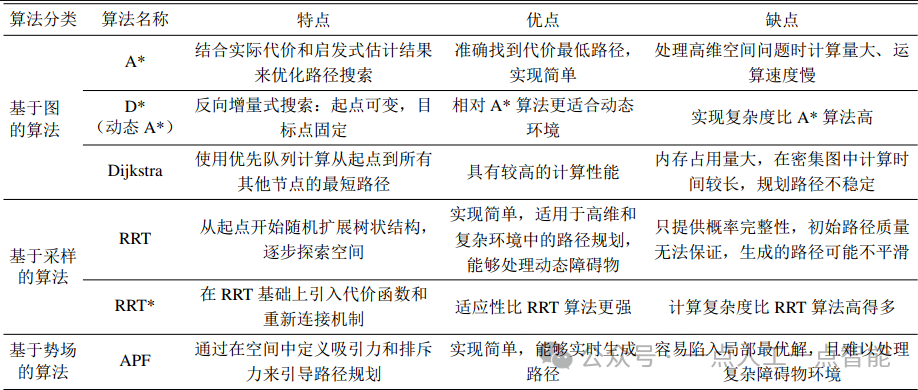

随着深度强化学习(DRL)技术的兴起,越来越多的研究中开始利用DRL来应对路径规划中的挑战。DRL结合了深度学习(DL)方法[1]的学习表征能力和强化学习(RL)方法[2]的决策制定能力,能够在交互和试错中优化路径选择策略,适应环境的动态变化和未知情况的出现[3]。因此,DRL算法逐渐成为路径规划领域的研究热点。  为了系统地梳理传统路径规划算法在解决路径规划问题时的特点及优缺点,对几种典型的传统算法进行了总结,并将具体内容整理于表1中。

为了系统地梳理传统路径规划算法在解决路径规划问题时的特点及优缺点,对几种典型的传统算法进行了总结,并将具体内容整理于表1中。

表1 传统路径规划算法的特点及其优缺点对比 1.1 基于图的算法

1.1 基于图的算法

Dijkstra[4]和A*[5]是两种著名的基于图的算法。Dijkstra算法的核心思想是使用优先队列(通常是最小堆)逐步地扩展从起点到其他节点的最短路径,再使用贪心策略来选择当前路径长度最短的节点。

A* 算法结合了Dijkstra算法的精确性和贪婪最佳优先搜索策略的启发式优势,能够高效地找到最优的路径,核心思想是使用代价函数f(n)=g(n)+h(n)来评估每个节点,其中g(n)表示从起点到节点n的实际代价,h(n)是从节点n到目标节点的启发式估计代价。启发函数h(n)的选择直接影响算法的效率和性能。

D* 算法[6]用增量反向规则取代了A* 算法中的启发式规则,结合了Dijkstra算法和A* 算法的优点,通过维护一个开放表和关闭列表来逐步缩小搜索范围,最终找到最优路径。

Zhu等[7]开发了一种反向标记Dijkstra算法(RLDA),与其他算法相比其收敛速度更快。Luo等[8]利用三角剖分法模拟地表环境,证明了扩展的Dijkstra算法能获得更精确、更短的曲面最优路径。这2种算法的性能均有一定提升,但计算时间都很长,为此,研究人员设计了A* 算法,通过引入启发式功能来测量实时搜索位置与目标位置之间的距离,相比Dijkstra算法,搜索更有针对性,提高了搜索速度。

文[9] 制定了终身规划A*(LPA*)算法,通过将增量搜索与A* 算法结合起来,避免了由于环境变化而重新计算整个图的问题。Lee等[10]针对A* 算法复杂度高的问题,引入了一种A* 算法和粒子群优化(PSO)算法结合的混合算法,新算法提高了路径的规划效率。

Zhang等[11]对A* 算法的代价函数进行了修改,根据不同的转弯角度动态调整权重以减少不必要的转弯,改进后的规划路径在障碍物附近的总转弯角度相对于A* 算法减少了60%。然而,上述A* 算法在动态环境下表现不佳,研究人员开始探索D* 算法来求解动态环境问题,文[12-13] 对D* 算法进行优化,提出了适用于移动障碍物环境和动态变化环境的改进方法。

基于图的算法主要适用于低维搜索空间,能为有限的搜索空间提供精确的解决方案。然而,在处理连续高维搜索空间的复杂场景时,这些方法往往由于计算量大而导致运算速度较慢,且所规划的路线不够稳定,限制了它们在复杂环境中的应用。

1.2 基于采样的算法

基于采样的方法(SBP)[14]用样本代表整体数据,从而减少计算量和时间开销,并在保持结果精度的前提下提高效率。快速扩展随机树(RRT)[15]是最常见的SBP方法,核心思想是通过从起点出发随机扩展树状结构,逐步探索整个空间,以寻找从起点到目标点的可行路径。RRT算法能够快速找到可行路径,但生成的路径可能不够光滑,通常需要通过优化技术RRT*[16]来进一步改进路径质量。

由于基于采样的算法只提供了概率完整性、生成的路径可能不平滑,为此,Wang等[17]提出了一种RRT和动态窗口方法(DWA)算法结合的混合算法(RRT-DWA),RRT算法用以寻找全局路径,而DWA算法用来估计旋转和平移速度,该算法比Dijkstra-DWA算法和A*-DWA算法具有更快的速度和更平滑的路径,但并未考虑动态环境。

Wang等[18]提出了一种基于动态目标偏差采样方法的改进RRT算法(Dyn-RRT),将DWA [19]集成到该算法中,增强了算法的方向性,缩短了机器人到达其位置所需的时间,但在复杂环境中容易陷入局部最优。Rong等[20]引入了一种基于机器学习的改进RRT* 算法(Attention-RRT*),虽优于传统RRT* 算法,但没有考虑准确性,统计分析不充分。

Wang等[21]设计了一种介于卷积神经网络(CNN)、A* 和RRT之间的混合算法(NRRT*)。A* 算法生成包含地图信息的训练数据集,利用CNN网络预测A* 算法得到的最优轨迹的概率分布,该分布使用RRT算法生成路径,结果优于其他RRT优化算法,但没有与环境进行在线交互。

基于SBP的规划方法只能提供概率完整性,在路径质量、平稳性和适应性方面存在不足,需要额外优化以改善路径的平滑性和长度。为此,研究者通常将SBP与其他方法结合,以降低路径的锐度使其更加平滑。对于复杂的搜索空间,将强化学习模型应用于SBP可以加速路径的规划过程,并细化复杂、动态环境中的轨迹。

1.3 基于势场的算法

人工势场(APF)法[22]是一种基于梯度的技术,通过在环境中定义虚拟的势场来引导机器人运动。该方法结合了吸引势场和排斥势场的优点,通过将目标点的吸引势场与障碍物的排斥势场相加,形成总势场,机器人沿着势场梯度的负方向移动,以此避开障碍物并朝向目标点运动。但APF算法的主要缺点是可能陷入局部最小值,即在某些位置,势场的合力使得机器人无法继续向目标移动,导致路径规划无法完成或路径不理想。

Di等[23]通过引入左调谐势场和虚拟目标点来解决上述局限性,但在封闭的障碍物环境下智能体无法到达目标点。Lu等[24]设计了自适应动态势场(ADPF)算法,利用ADPF算法的动态特性绘制周围环境图,并通过最小化考虑周围障碍物的势场来生成无碰撞的轨迹,该算法在性能方面优于其他传统算法,但在鲁棒性方面还有待加强。

Zhang等[25]提出了A* 和APF算法结合的混合算法(AplusPF),将机器人动力学融入到A* 算法的迭代过程中,在充分考虑水下机器人动力学约束和位置姿态信息的情况下,规划出安全、可跟踪的路径。此外,在A* 算法的启发式函数中加入了对AUV轨迹的预测,从而更精准地引导搜索方向,该算法解决了A* 算法在复杂多障碍物环境下运行速度慢的问题,但计算复杂度较高。

APF法在解决路径规划问题时易陷入局部最优解,且对障碍物形状有一定要求。目标点附近有障碍物或障碍物形状不规则时,可能出现路径规划失败或计算量剧增情况。鉴于传统路径规划算法的局限性,研究人员开始探索新算法来优化路径规划,深度强化学习算法作为一种极具潜力的解决方案逐渐受到关注,具体实现方法及优势详见第4节。  2.1 强化学习基础

2.1 强化学习基础

强化学习起源于最优控制理论(OCT)[26]和马尔可夫决策过程(MDP)[27],20世纪50年代,Bellman[28]首次揭示了动态规划与拟线性方程之间的联系[29],在20世纪80年代,无模型的强化学习受到了广泛关注[30]。

强化学习是一种机器学习方法,侧重求解顺序决策问题,旨在使智能体通过与环境的互动来学习如何采取行动,从而最大化累积奖励。很多现实问题都可以归为此类,例如电子游戏、自动驾驶、机器人控制等。

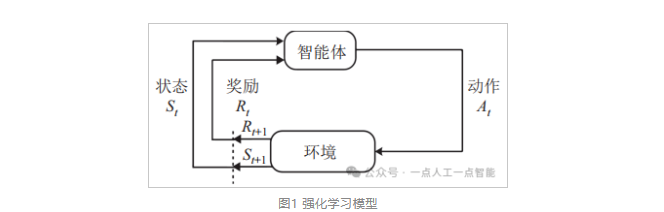

强化学习基本构成包括5部分。

1) 智能体:是执行动作并从环境中获得反馈的实体。根据环境状态采取行动,并根据这些行动的结果来调整其策略。

2) 环境:是智能体交互的对象,为智能体提供状态信息,并根据智能体的动作返回奖励和下一个状态。

3) 状态:表示环境在某一时刻的情况,智能体根据当前状态决定其行动。

4) 动作:是智能体在特定状态下选择的行为,决定了智能体与环境的互动方式。

5) 奖励:是环境对智能体动作的反馈,用于评估该动作的好坏。奖励信号帮助智能体学习哪些动作是有利的。

智能体接收环境在每个时间步的当前状态,并根据其策略选择一个动作,执行该动作后,环境会返回一个奖励和新的状态,智能体的目标是在多个时间步内获得尽可能多的奖励。当状态→动作→奖励循环结束时,一个时间步完成,循环往复,直至环境结束(如找到路径最优解)。整个过程可用图1来描述[31]。  强化学习问题通常使用MDP进行形式化,MDP提供了一个通用框架,用于解决不确定环境中的决策问题,并且可以通过动态规划、蒙特卡洛(MC)算法[32]以及时序差分(TD)[33]等技术进行求解。MDP的核心基础是马尔可夫性质,是随机过程的一种重要概念,表示一个过程的未来状态仅依赖于当前状态,而与过去的状态无关[34],其图模型表示如图2所示。

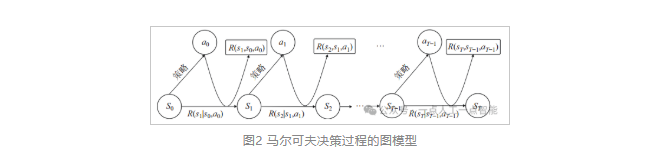

强化学习问题通常使用MDP进行形式化,MDP提供了一个通用框架,用于解决不确定环境中的决策问题,并且可以通过动态规划、蒙特卡洛(MC)算法[32]以及时序差分(TD)[33]等技术进行求解。MDP的核心基础是马尔可夫性质,是随机过程的一种重要概念,表示一个过程的未来状态仅依赖于当前状态,而与过去的状态无关[34],其图模型表示如图2所示。

MDP问题由四元组M=⟨S,A,P,R⟩来描述,其中,S为环境的状态空间,表示所有可能状态的集合{s0,s1,⋯,sT};A是智能体动作空间at∈A,表示所有可能动作的集合{a0,a1,⋯,aT−1};P是状态转移概率,表示在当前状态采取某个行动后,转移到下一个状态的概率,记为P(st+1|st,at);R是奖励函数,表示在当前状态采取某个行动获得的即时奖励,记作R(st+1,st,at)。  2.2 深度强化学习基础

2.2 深度强化学习基础

2013年谷歌公司的DeepMind团队提出了DQN(deep-Q-network)算法,将深度学习与强化学习结合,为复杂系统的控制提供了强有力的工具。

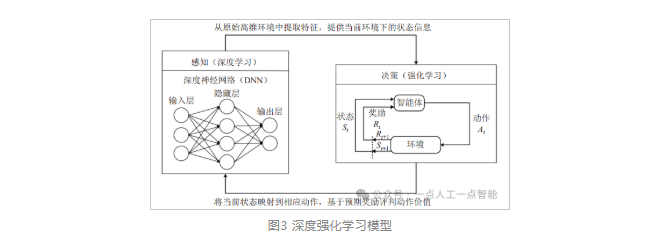

深度强化学习在结构上仍然保持着强化学习的核心框架,专注于解决决策问题,在智能体的动作选择上引入了深度神经网络(DNN)。DNN包含多种类型,如图神经网络(GNN)[35],处理图结构数据的神经网络模型;前馈神经网络(FNN)[36],信息在输入层到输出层之间单向流动的神经网络;生成式对抗网络(GAN)[36],通过生成器和判别器的对抗训练来生成逼真的数据。

深度强化学习模型如图3所示。在智能体学习过程中使用DNN(包括输入层、隐藏层和输出层)作为函数逼近方法[38],实现对原始数据的高层次特征抽取。这些方法能够利用低维特征表示高维数据并进行自动化分析,依据模型结果作出决策。  引入神经网络模型的原因主要在于处理庞大且复杂的状态—动作空间时所面临的挑战,因此需要利用该模型直接拟合策略。这在路径规划问题中可以视为2个步骤:地图信息到状态的映射和状态到动作的映射,分别由深度学习和强化学习来完成。而由于神经网络的黑箱性质[39],深度强化学习能够以一种端到端的方式通盘考虑整个决策过程,而无需显式地表现或建模每一个中间状态。深度强化学习的发展诞生了一系列的算法,这些算法为研究路径规划提出了新的思路和更好的技术路径。

引入神经网络模型的原因主要在于处理庞大且复杂的状态—动作空间时所面临的挑战,因此需要利用该模型直接拟合策略。这在路径规划问题中可以视为2个步骤:地图信息到状态的映射和状态到动作的映射,分别由深度学习和强化学习来完成。而由于神经网络的黑箱性质[39],深度强化学习能够以一种端到端的方式通盘考虑整个决策过程,而无需显式地表现或建模每一个中间状态。深度强化学习的发展诞生了一系列的算法,这些算法为研究路径规划提出了新的思路和更好的技术路径。

2.3 深度强化学习算法的分类

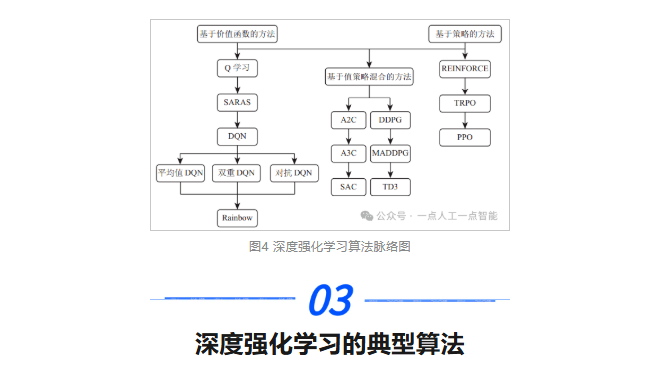

在DRL中,算法的分类和发展成为关键焦点之一,通过有效的算法分类,可以帮助理解和比较不同方法在不同场景下的应用效果。

求解DRL问题的方法分为基于价值函数、策略和值策略混合3种类型。

· 基于价值函数的方法根据价值函数的大小推导出最优策略,进而选择动作;

· 基于策略的方法直接在策略空间中进行搜索以找到最优策略,而不是通过价值函数来间接推导;

· 基于值策略混合的方法使用价值函数来评估当前状态的价值,基于这些价值信息来更新和优化策略,旨在克服前2种方法的局限性,实现更高效的学习和决策过程,从而在实际动作中获得更高的长期奖励。

图4按照时间顺序给出了每类方法中主要的深度强化学习算法以及它们之间的关系。  3.1 基于价值函数的算法

3.1 基于价值函数的算法

基于价值函数的强化学习方法使用DNN来逼近价值函数,通过学习状态或动作的价值来优化决策。根据自变量的不同,价值函数可分为状态价值函数Vπ(s)和状态动作价值函数Qπ(s,a)。智能体通过学到的价值函数来计算动作对(s,a)。

3.1.1 Q学习算法

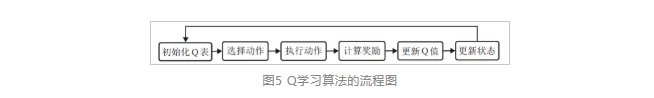

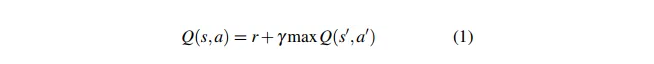

Q学习算法[40]是一种经典的基于价值函数的算法,核心思想不是已知一个策略去优化它,而是新建一个策略,采用表格形式来存储Q值(或称为动作价值函数),该Q表中每个状态有一行,每个动作有一列,每个单元格都包含相应状态—动作对的估计Q值。其输入是状态和动作,输出是各个状态和动作的价值,通过不断更新表格来学习如何在一个给定的环境中执行最佳动作,最终得到一个训练较好的Q表[41]。算法具体流程如图5所示。  Q学习算法的目的是学习动作选择策略πt(a|s)使奖励最大化,πt(a|s)表示st=s、at=a时的概率分布,Q函数Q:S×A→R产生具有折扣因子γ的折扣累计奖励:

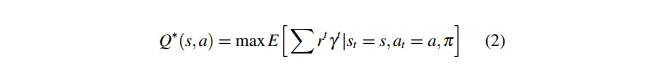

Q学习算法的目的是学习动作选择策略πt(a|s)使奖励最大化,πt(a|s)表示st=s、at=a时的概率分布,Q函数Q:S×A→R产生具有折扣因子γ的折扣累计奖励:  通过维护并更新Q值获得最佳动作价值函数:

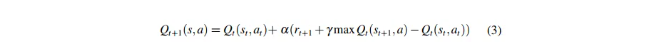

通过维护并更新Q值获得最佳动作价值函数:  每个时间步都使用式(3) 来更新Q值:

每个时间步都使用式(3) 来更新Q值:  具体来说,Q学习算法试图在给定的状态下估计某个动作的长期期望收益,它能够在对环境不完全了解的情况下学习最优策略。然而,它也存在一些局限性。

具体来说,Q学习算法试图在给定的状态下估计某个动作的长期期望收益,它能够在对环境不完全了解的情况下学习最优策略。然而,它也存在一些局限性。

首先,在更新Q函数时使用的是下一时刻最优值对应的Q值,而这个最优值可能是不准确的,从而导致估计值过高;

其次,在状态很多的情况下,Q表会很大,查找和存储都需要消耗大量的时间和空间,此外,随着状态空间维数的增加,状态动作组合数量会爆炸性增长,将导致可用于学习和训练的数据变得稀疏,机器学习性能下降[42]。

3.1.2 SARAS算法

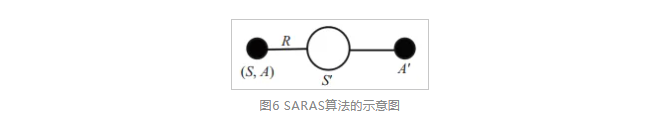

SARAS(state-action-reward-state-action)[43]的命名来源于“在执行更新之前需要了解状态—动作—奖励—状态—动作”的说法,强调了算法在强化学习中使用状态—动作—奖励序列的结构。这一命名反映了算法的基本思想,即通过对状态和动作的持续交互来学习最优策略。SARAS算法在更新Q值时考虑了未来下一个动作的Q值,其更新依赖于智能体实际采取的动作,而非最佳动作。

图6给出了SARAS算法的示意图,由五元组<S,A,R,S′,A′>下采用当前的行为策略产生一个新动作A,智能体此时并不执行该动作,而是通过动作价值函数得到后一个状态动作对⟨S′,A′⟩的价值,利用这个新的价值和即时奖励R来更新前一个状态动作对⟨S′,A′⟩的价值。  SARAS算法包含2个核心思想。

SARAS算法包含2个核心思想。

第1个核心思想是基于时序差分(TD)技术,通过智能体与环境的实时交互来更新Q值,并基于当前策略进行学习。

第2个核心思想是使用Q函数生成动作,这涉及智能体如何找到良好动作的问题。

然而,SARAS算法存在方差大且在智能体训练过程中效率不高的缺点。

3.1.3 DQN算法

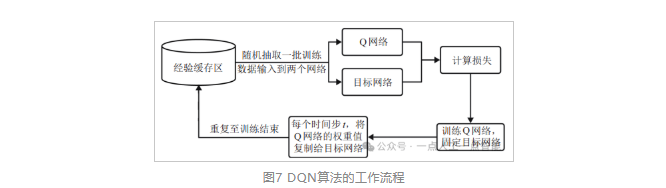

DQN算法是深度学习领域首次广泛应用于强化学习的算法模型之一,它是由Mnih等[44]在2013年提出来的,是使用RL直接从高维的图像数据中学习控制策略的第一个示例[45]。DQN算法是一种将DL与Q学习算法结合起来的强化学习算法,主要用于解决高维状态空间中的决策问题[46]。其核心原理是使用深度神经网络来近似Q值函数,通过输入状态得到各动作的Q值。其体系结构包括Q网络、目标网络,以及经验回放单元。

图7详细描述了DQN算法的工作流程。DQN引入了经验级优先回放机制,将智能体的经验存储在池中,随机采样进行训练,使打破数据的时间相关性和允许同一样本参与多次参数更新成为可能,并且允许使用同一批采样进行多个参数的更新,增强了样本的效率和稳定性。损失函数通过计算当前Q值与目标Q值之间的差异来进行优化。

此外,DQN还使用固定目标网络,以降低训练过程中的波动,在Q网络参数更新一定步数后,将Q网络的权重值全部复制给目标网络,为了平衡探索与利用,DQN采用ε贪婪策略逐步降低探索频率。  DQN在多个复杂环境中表现出色,成为强化学习领域的重要突破。同时,近几年研究者们提出了多种DQN改进算法以提升算法性能,包括平均值DQN[47]、双重DQN(DDQN)[48]以及对抗DQN[49]等。

DQN在多个复杂环境中表现出色,成为强化学习领域的重要突破。同时,近几年研究者们提出了多种DQN改进算法以提升算法性能,包括平均值DQN[47]、双重DQN(DDQN)[48]以及对抗DQN[49]等。

3.2 基于策略的算法

基于策略的算法可以直接学习并优化策略函数,通过最大化预期奖励来实现最优决策。与价值函数方法不同,在交互过程中,智能体利用累积奖励评估当前策略,并通过计算策略梯度来调整参数,实现策略改进。这一迭代过程——采样、评估和改进——不断进行,在每次迭代中智能体的策略都会得到增强,逐步逼近最优策略。这类算法能适应复杂的高维环境,特别适合解决连续动作空间的问题。

此外,正如Sutton等[50]在策略梯度定理中所证明的,这类方法保证了收敛到局部的最优策略,核心在于通过数学模型、概率论、优化理论等方法,来模拟和评估不同决策的可能结果。它们可以处理大量的输入信息,通过计算和分析选择预期效果最好的行动方案,通过这种方式,智能体能够在复杂任务中实现更为精准的决策。

3.2.1 Reinforce算法

Reinforce算法[51]是一种最基本的策略梯度算法,它学习一种参数化的策略,该策略可根据当前状态产生相应的动作概率,而智能体可以直接根据此动作概率在环境中选择动作。其核心思想是利用策略函数进行参数优化,动态调整智能体在状态s下选择动作a的概率分布,即在训练过程中逐渐增加获得良好结果动作的概率,同时降低不良结果动作的概率。如果训练成功,随着多次迭代循环的进行,所学习的策略将逐渐调整其动作概率分布,使其更加倾向于那些在实际环境中表现优异的动作。

核心原理分为4个步骤:

1) 策略采样:智能体依据当前策略π(θ)与环境交互,产生一系列状态、动作、奖励序列(即一条轨迹τ)。

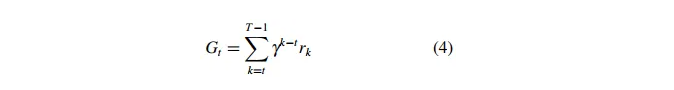

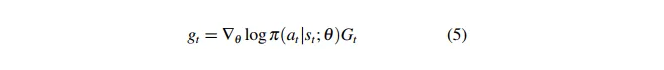

2) 奖励计算:对轨迹τ进行奖励计算,通常采用折扣累计奖励,计算公式如下:  3) 梯度估计:基于蒙特卡洛方法,通过遍历轨迹τ中的每一步,计算对应状态动作对的梯度估计:

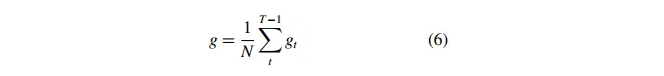

3) 梯度估计:基于蒙特卡洛方法,通过遍历轨迹τ中的每一步,计算对应状态动作对的梯度估计:  将所有时间步的梯度估计累加得到完整的策略梯度估计:

将所有时间步的梯度估计累加得到完整的策略梯度估计:  4) 策略更新:使用梯度上升法更新策略参数θ。

4) 策略更新:使用梯度上升法更新策略参数θ。  3.2.2 TRPO算法

3.2.2 TRPO算法

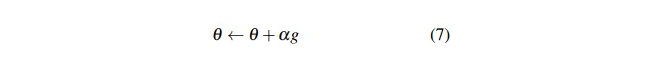

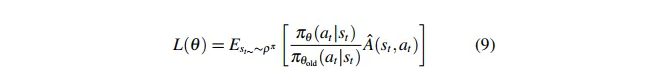

信赖域策略优化(TRPO)算法[52]通过优化策略来寻找最佳行为,以使智能体在特定环境中获得更高的奖励。其核心思想是引入了信赖域约束来限制参数更新的步长,以保证算法的收敛性和稳定性。在更新时找到一块信任区域,在这个区域更新策略时确保了新策略与旧策略之间的KL散度[53]不会太大,从而避免策略更新过大可能导致性能下降的问题。信赖域约束可以表示为  其中,DKL表示KL散度,πθ(at|st)是当前策略的概率分布,图片是上一个策略的概率分布,δ是一个预设的小值,控制策略更新的幅度。

其中,DKL表示KL散度,πθ(at|st)是当前策略的概率分布,图片是上一个策略的概率分布,δ是一个预设的小值,控制策略更新的幅度。

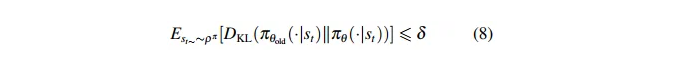

TRPO算法直接对策略进行优化,不需要估计价值函数,通过优化策略的更新步长来改善梯度方法的不足,其优化目标函数可以表示为  其中,图片是优势函数[54]。

其中,图片是优势函数[54]。

此外,TRPO算法还引入了重要性采样[55]和广义优势估计[56]等技术,以进一步优化策略的更新过程。

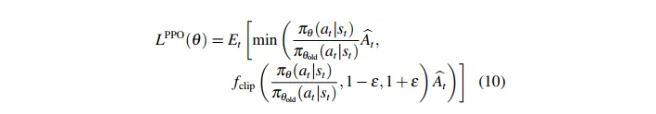

3.2.3 PPO算法

在采用策略梯度算法进行智能体训练的过程中,存在系统性能急剧下降的问题,这是由于智能体会先产生性能较差的路径,再利用这些路径进行下一步的策略训练,导致规划结果出现死锁、碰撞等问题。同时,基于相同策略的算法,因其不能重复使用,使得样本的利用率较低。

Schulman等[57]提出的PPO(近端策略优化)算法是解决以上2个问题的优化算法。核心思想是通过限制策略更新的幅度,确保训练过程的稳定性和高效性。PPO算法引入了“剪切”目标函数,通过将原始目标函数替换为修改后的目标函数,避免了策略更新过大导致的不稳定性,同时使用优势估计来提升样本效率。具体来说,PPO的目标函数可以表示为  其中,fclip表示将一个值限制在一个指定的范围内,ε是一个超参数,控制剪切的幅度,剪切函数将比率限制在[1−ϵ,1+ε]的范围内,通过这种方式,PPO算法避免了策略的过度更新,同时保证了目标函数的有效性。

其中,fclip表示将一个值限制在一个指定的范围内,ε是一个超参数,控制剪切的幅度,剪切函数将比率限制在[1−ϵ,1+ε]的范围内,通过这种方式,PPO算法避免了策略的过度更新,同时保证了目标函数的有效性。

PPO算法的优化可用于扩展Reinforce算法,该算法能够利用多个时间步的数据进行多次更新,解决了步长难以确定的问题,进一步提高了学习效果。这种修改可以实现更稳定、样本利用更充分的训练,在处理连续动作空间问题时表现出色,并且其稳定性和计算效率已在多种任务和复杂环境中验证。

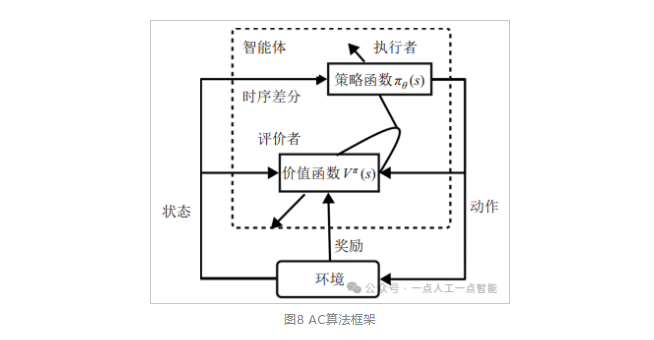

3.3 基于值策略混合的算法

基于价值函数和基于策略的方法在强化学习领域各具特色,然而它们同样存在一些缺陷。前者依赖于预定义的任务价值,同时需要平衡任务价值和智能体数量之间的关系。后者受限于策略空间的复杂性和搜索效率,可能出现局部最优解和计算资源需求过高问题[58]。

为了充分利用每种方法的优势,研究者们综合了基于价值、策略算法的思想,研究了新的深度强化学习算法,即值策略混合方法,该方法能够更有效地应对连续动作空间和高维状态空间问题。这类算法被命名为AC(actor-critic)算法。基本原理是用策略指导动作,价值函数会对动作进行评价,算法具体框架如图8所示。  算法分为2个部分,其中,执行者是策略函数πθ(s),通过神经网络实现,输入为当前状态,输出为一个动作,训练目标是最大化累计奖励的期望值;评价者是价值函数Vπ(s),它用于估计当前策略,来评估执行者的优劣。通过策略网络和价值网络的结合,能够同时学习策略并优化价值函数,二者相辅相成形成了执行者—评价者。

算法分为2个部分,其中,执行者是策略函数πθ(s),通过神经网络实现,输入为当前状态,输出为一个动作,训练目标是最大化累计奖励的期望值;评价者是价值函数Vπ(s),它用于估计当前策略,来评估执行者的优劣。通过策略网络和价值网络的结合,能够同时学习策略并优化价值函数,二者相辅相成形成了执行者—评价者。

AC算法有多种拓展算法,其中应用最广泛的有DDPG、A3C、TD3和SAC等算法。

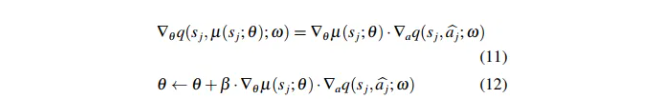

3.3.1 DDPG算法

DDPG算法[59]是确定性策略梯度(DPG)法[60]与深度学习法的结合,用于解决连续控制问题。该算法基于AC架构,同时采用了DQN的学习策略,因此,DDPG是一种专门针对连续动作空间设计的、采用在线策略的无模型深度强化学习算法,其本质为DNN+DPG,之所以叫确定性策略梯度,是因为其动作网络输出的是一个确定的动作而不是动作概率。该算法具体框架见如9所示[61]。

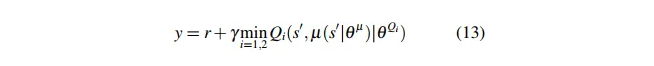

在状态s下,初始化策略网络、价值网络以及2个网络的参数值θ和ω,学习过程采用DQN的经验回放机制,通过优化价值网络使之逼近动作价值函数Qπ(s,a),不断优化策略网络的参数,使其输出的动作a在价值网络中能够得到越来越高的评分。价值网络使用TD算法进行更新,为了防止过高估计,引入目标网络进行计算,本质也是链式法则,其公式以及更新方式如下:  3.3.2 A3C算法

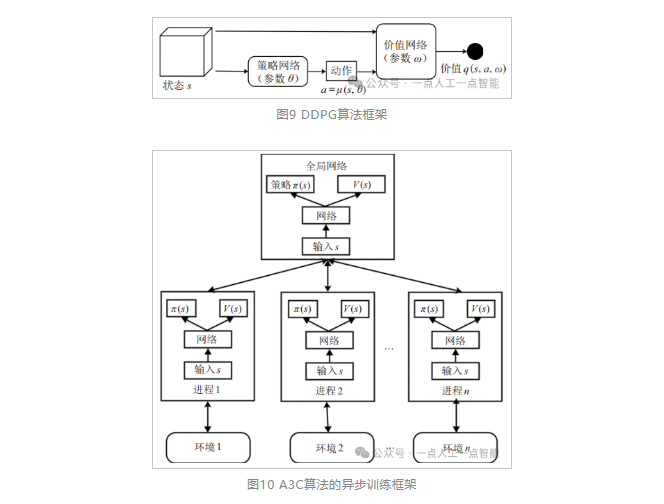

3.3.2 A3C算法

A3C算法[62]的发展是对DQN算法的一个重要延伸和改进,相比DQN算法有诸多优点。首先,A3C算法通过多个并行智能体进行训练,采用异步更新策略,提高了样本效率,增强了训练的稳定性并避免过早收敛的风险;其次,它能够处理连续动作空间,而DQN主要适用于离散动作;此外,A3C算法同时学习策略和价值函数,通常在复杂环境中表现更佳。这些优势使得A3C算法在多种复杂任务中更具竞争力。

A3C算法在AC框架基础上的主要优化有3点:异步训练框架、网络结构优化以及评价者评估点的优化,其中异步训练框架的贡献更基础、影响更广泛,其框架如图10所示。  全局网络是一种通用的神经网络,包含全局策略和全局价值函数。A3C算启动多个工作线程,每个线程都拥有独立的环境实例,并共享相同的全局网络结构,这些线程通过复制全局网络的参数来初始化各自的本地网络。

全局网络是一种通用的神经网络,包含全局策略和全局价值函数。A3C算启动多个工作线程,每个线程都拥有独立的环境实例,并共享相同的全局网络结构,这些线程通过复制全局网络的参数来初始化各自的本地网络。

每个线程会利用收集的数据计算优势函数和目标值,之后使用策略梯度方法计算相对于全局网络的梯度,这个梯度值并没有用来更新自己的神经网络,而是将计算得到的梯度发送到全局网络,全局网络应用这些梯度更新其参数,定期将更新的参数复制到每个本地网络,以保证所有线程使用相同的策略。

3.3.3 TD3算法

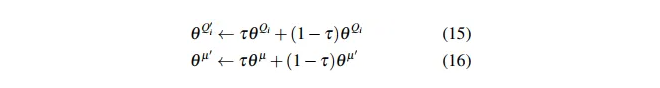

TD3算法[63]是一种适用于连续动作空间的算法,旨在改进DDPG算法的稳定性和性能。通过引入2个Q网络来减小Q值的过估计偏差,采用延迟更新策略使策略网络和目标网络的更新频率低于Q网络,避免训练过程不稳定。此外,TD3算法在目标Q值计算中使用了目标网络和软更新方法,使网络参数更新更加平滑。

为了进一步提高算法的鲁棒性,TD3算法还在目标策略网络中加入了噪声,以增强探索能力。这些改进使得TD3算法在处理复杂的连续动作空间任务时表现得更加稳定和高效。其网络结构涉及的主要改进如下:

1) 双重Q网络:

TD3算法使用2个Q网络图片和图片来减小Q值的过估计偏差,更新目标时使用如下公式:  2) 目标网络

2) 目标网络

使用目标Q网络图片和图片以及目标策略网络μ′来计算目标值,目标Q值的计算公式为  目标网络参数更新使用软更新:

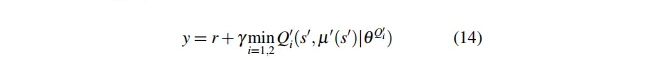

目标网络参数更新使用软更新:  3.3.4 SAC算法

3.3.4 SAC算法

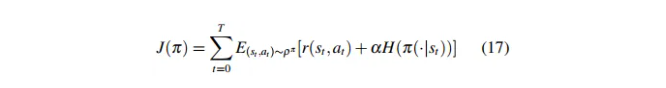

SAC算法[64]在优化过程中引入了熵正则化和软化策略更新的概念,使得智能体在学习过程中能够更好地探索未知的状态,提高学习效率。

此外,SAC采用了一个类似TD3算法中的截断双Q值技巧,使用2个Q网络,并通过取最小Q值的方式来避免因策略更新或价值函数更新时对Q值直接进行最大化操作带来的高估。

SAC算法的目的是使未来累积奖励值和熵最大化,使得策略保持高度的随机性,即确保动作输出的概率分布尽可能分散,避免过度集中于某一特定动作。其目标函数为  其中,ρπ表示在策略π下r(st,at)的分布,H(⋅)表示熵值,α表示超参数,目的是控制最优策略的随机程度以及权衡熵相对于奖励的重要性。

其中,ρπ表示在策略π下r(st,at)的分布,H(⋅)表示熵值,α表示超参数,目的是控制最优策略的随机程度以及权衡熵相对于奖励的重要性。

SAC算法的性能表现是非常稳定的,在不同环境下训练依然能够获得相似的性能表现。此外,算法本身对超参数不敏感,基本不需要对超参数进行调整,在不同的交互环境中设置同样的超参数依然能够获得优秀的性能[65]。

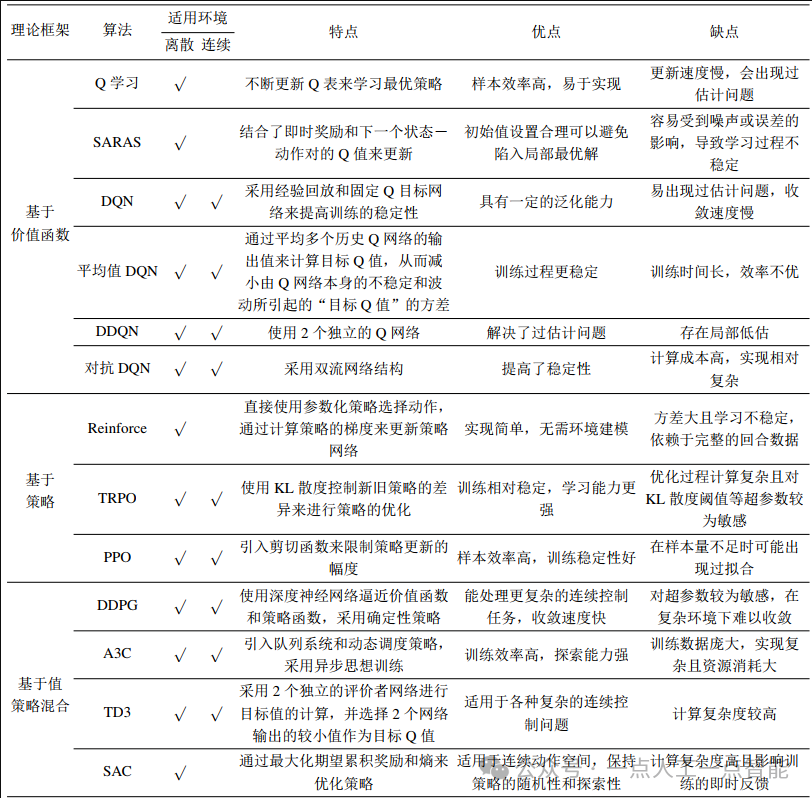

表2对各类算法进行了归纳总结。

表2 深度强化学习典型算法比较

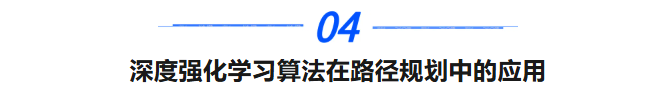

作为一种新兴技术,深度强化学习提供了一种新的解决方案。本节总结了基于深度强化学习算法的路径规划技术在真实应用环境和模拟环境中的研究进展,列举了近期研究成果和影响力较大的工作,具体内容见表3。

作为一种新兴技术,深度强化学习提供了一种新的解决方案。本节总结了基于深度强化学习算法的路径规划技术在真实应用环境和模拟环境中的研究进展,列举了近期研究成果和影响力较大的工作,具体内容见表3。

表3 基于深度强化学习算法在路径规划应用总结与对比 4.1 真实应用环境

4.1 真实应用环境

4.1.1 自动驾驶

作为自动驾驶系统的核心组成部分之一,路径规划在确保车辆安全且高效地到达目标位置方面发挥了至关重要的作用。高效的路径规划不仅要求算法能够实时处理车辆当前的环境信息,还需对未来的道路情况进行准确预测,以应对动态和复杂的驾驶环境。

Ni等[66]提出了一种基于Q学习算法的多策略综合人工蜂群(QMABC)算法[67],在QMA\-BC算法中提出了多种搜索策略,以利用不同的个体经验和搜索方法更新解决方案,然后采用Q学习算法进行策略选择,该方法在Q学习算法的框架内引入了更有效的状态和动作配置。实验过程中采用CEC 2017基准函数,与ABC变体和其他元启发式算法相比,QMABC算法在搜索精度、收敛速度和鲁棒性方面具有很大的优势。

Ye等[68]为了提高TRPO轨迹规划方法的鲁棒性,提出了TRPO-LSTM决策模型。具体而言,设计了基于长短期记忆(LSTM)[69]的状态特征提取网络,并将其嵌入到决策模型中,增强了TRPO从环境状态空间中提取信息的能力。其次,为了使规划的轨迹能够适应交通环境的动态变化,提出了轨迹拟合算法,其在四车道高速公路场景下的累计奖励提升超过28.9%。此外,该方法在提高车辆平均行驶速度和舒适度的同时,实现了0.93% 的低碰撞率,但模型训练效率较低。

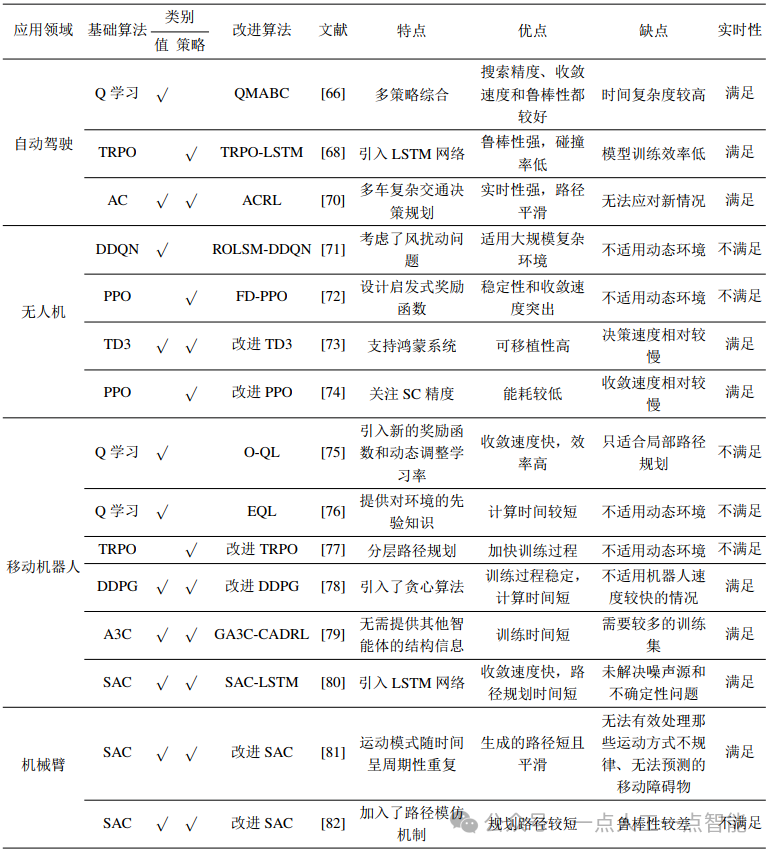

针对自动驾驶的安全和效率问题,Xu等[70]提出了一种适用于多车辆复杂交通场景的AC强化学习(ACRL)算法。ACRL算法中的策略网络分为车道保持和换道2个子网络,奖励功能旨在提高效率、安全性和驾驶舒适性,通过图11所示的车头时距(TH)和速度分布仔细提取真实交通特征。实时实验结果表明,ACRL算法比传统算法实时性更强,具有更平滑的路径,但该算法基于预先训练的网络,不能处理新情况。  4.1.2 无人机

4.1.2 无人机

无人机的飞行环境通常较为复杂,具有高度的动态性和不确定性。与传统的地面车辆不同,无人机需要在3维空间中进行路径规划,不仅涉及无人机从起点到目标点的路径设计,还需要考虑飞行过程中的能量损失、天气条件以及其他动态因素的影响,增加了问题的复杂性。

针对无人机的能量消耗问题,Zhu等[71]提出了改进的DDQN算法(ROLSM-DDQN)。将风扰动融入能量消耗模型和奖励函数中,能够有效地描述无人机执行任务时的风扰动,实现了最小阻力飞行。此外,采用线性软更新策略实现神经网络参数的平滑更新,增强了训练的稳定性和收敛性。

与传统的DQN算法相比,ROLSM-DDQN的步数、成本和路径长度分别减小了5.41%、7.58% 和10.23%;与传统的DDQN算法相比,分别减小了6.25%、8.60% 和10.23%,成功解决了大规模复杂环境下的路径规划问题。然而,该算法属于离线规划,需要对全局信息进行预测,不能满足实时需求,不适用于动态环境。

Qi等[72]提出了频率分解—PPO算法(FD-PPO),设计启发式奖励函数来解决无人机路径规划问题,在建模过程中考虑无人机的实际运动模型,选择连续动作空间。该算法将奖励分解为多维频率奖励,能够适应复杂的环境,并且在连续状态空间和动作空间下具有突出的稳定性和收敛速度。对比实验表明,FD-PPO算法在平均奖励、路径长度和成功率方面都优于PPO算法。但该算法不适用于有动态障碍物的环境。

针对无自主人机在陌生环境下的局部避障问题,Zhao等[73]提出了一种基于TD3算法的局部路径自主规划算法。该算法在无障碍物干扰条件下成功率可达93%,在有障碍物环境下成功率可达92%,而且该算法支持鸿蒙系统,具有良好的可移植性,无需改变无人机的本机控制器,只需修改部分参数,就可以在其他无人机设备上工作,但在智能体的决策速度上还有待提高。

在频谱制图(SC)中利用无人机进行数据采集,因其灵活性和较低的运营成本备受研究者们关注,为了解决现有方法无法获得SC精度的即时反馈的问题,Li等[74]使用PPO算法,利用基站提供的延迟交互信息,并构造回溯优势函数进行训练,以应对现实场景中的稀疏反馈问题,避免收敛到局部解,最终目标是优化无人机的飞行轨迹,寻求动态发射环境下信息量最大的结果。仿真结果表明,与传统算法相比,该算法可以达到更高的SC精度和更低的能耗。

4.1.3 移动机器人

移动机器人通常在高动态和不确定的环境中运作,这些环境包括静态障碍物和动态物体(如行人或其他机器人),加剧了路径规划任务的复杂性与挑战性。

针对Q学习算法收敛速度慢,容易陷入局部最优解的问题,Zhou等[75]提出了优化版的Q学习(O-QL)算法,O-QL算法引入了新的Q表初始化方法、动作选择策略和奖励函数,并在学习率调整中采用了均方根传播方法。对比实验表明,在步长、奖励回报、学习率变化和运行时间方面,O-QL算法均优于Q学习算法。

Maoudj等[76]提出了EQL(efficient Q-learning)算法,为智能体提供对环境的先验知识,通过缩小搜索空间来加速学习过程,同时保证快速收敛到最优解。EQL算法在路径长度、计算时间和安全性方面均优于其他优化算法。

Fan等[77]选择分层路径规划方法。首先,将路径规划器分解为感知层、规划层和控制层3层结构,利用边缘检测方法寻找潜在的边界进行跟踪,将路径搜索空间从整个地图缩小到几个感兴趣的点,极大节省了训练和执行过程中的计算资源;其次,采用TRPO作为判断器,选择机器人跟踪的最佳边界,保证了路径规划器以较短的路径长度获得最优性能,与DQN算法相比,该方法在训练过程中能够更快地收敛到有效策略。

Dong等[78]在DDPG算法基础上,使用少量的先验知识加速训练,减少试错的次数,并采用基于ε贪婪算法的自适应探索方法,动态调整勘探因子,合理配置勘探开发概率。通过对比实验表明,相比Q学习和SARSA算法,改进算法的计算时间更短、收敛速度更快,但这一优越性的前提是动态机器人的速度必须小于规划机器人的速度。

Everett等[79]提出了改进的A3C算法(GA3C-CADRL),实现了在不需要了解其他智能体动态的前提下就能进行路径规划。此外,还提出了一种创新策略,允许算法在网络输入端使用LSTM网络,根据对附近任意数量智能体的观察结果来选择合适的操作。随着智能体数量的增加,该算法在训练时间和轨迹长度上均优于传统方法,此外,该算法还特别适用于以人类步行速度移动的智能体环境。

针对动态环境下的路径规划问题,Zhang等[80]提出了改进的SAC算法(SAC-LSTM),该算法基于LSTM框架,对状态空间、动作空间、奖励函数和总体规划流程进行了改进,建立了移动机器人的运动模型。与SAC算法相比,在动态障碍物环境下到达目标点的成功率提高了10.5%,此外,规划时间更短、规划的路径更简洁。但该算法没有解决现实环境中存在的噪声和不确定性问题,包括传感器噪声、环境波动和障碍物移动的不确定性。

4.1.4 机械臂

机械臂在路径规划中需要满足高自由度和精确操作需求、高维空间中的计算复杂性以及动态环境中的交互要求,这些特点使得机械臂的路径规划需要处理复杂的运动学模型、动态变化的环境,并兼顾多种任务需求。

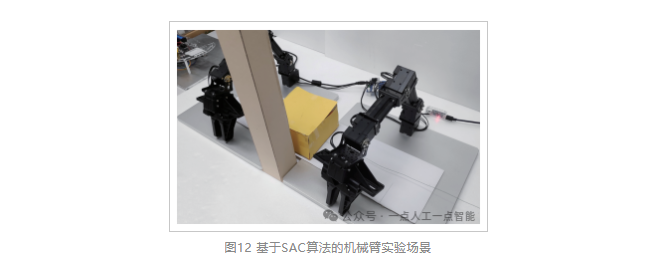

针对机械臂现有研究主要集中在静态障碍物上的问题,Prianto等[81]提出了一种基于SAC的路径规划算法,用于在多机械臂环境中处理静态与周期性运动的障碍物,利用过去一段时间范围内移动障碍物的位置信息来设计神经网络。此外,采用后验经验回放(HER)技术对训练数据进行有效利用。如图12所示,该算法使用2个开源机械臂进行了测试,比TD3算法规划的路径更短、更平滑。  针对动作空间和状态空间巨大导致奖励稀疏的问题,Song等[82]提出了一种基于路径模仿和SAC算法的机械臂路径规划算法。该算法在训练过程中将示范路径融入奖励函数中,使机械臂在学习过程中对示范路径进行模仿以提高学习效率。

针对动作空间和状态空间巨大导致奖励稀疏的问题,Song等[82]提出了一种基于路径模仿和SAC算法的机械臂路径规划算法。该算法在训练过程中将示范路径融入奖励函数中,使机械臂在学习过程中对示范路径进行模仿以提高学习效率。

通过对比实验可知,在规划的10条参考路径中,所提算法与DDPG算法获得的平均距离分别是0.8和1.9 cm,表明改进的SAC算法在探索环境方面表现更优,能够规划出更加合理的路径。

4.1.5 物流与仓储系统

物流与仓储系统面临着包括订单处理复杂、仓库空间利用率低以及运输路径规划效率低下等问题,路径规划问题已成为货物运输和快速分拣领域的关键技术问题。

针对图13的仓库货物分拣系统,Chen等[83]基于DDQN算法提出了分散式多机器人避碰方法,根据机器人在行驶过程中要避免碰撞和方向改变尽量小的2个特点来改进奖励函数,改进方法不仅适用于大规模系统,而且可以直接处理激光雷达信号,不需要机器人之间进行通信,实验结果表明改进算法克服了DQN算法的局限性,但在性能方面表现较差。  Shen等[84]针对Kiva系统的仓库布局场景,利用优势函数和熵进行训练,结合MAA3C算法的注意机制,将A3C算法与注意力机制相结合,并参考交叉熵和优势函数训练更好地解决仓储多拣站中拣架数量不等的路径规划问题。

Shen等[84]针对Kiva系统的仓库布局场景,利用优势函数和熵进行训练,结合MAA3C算法的注意机制,将A3C算法与注意力机制相结合,并参考交叉熵和优势函数训练更好地解决仓储多拣站中拣架数量不等的路径规划问题。

4.1.6 无人水下航行器

路径规划是沿海船舶领域的关键问题,也是船舶智能化发展的核心基础。针对全局路径规划和避障问题,Wang等[85]提出了PPO驱动的NSFQ(神经网络平滑的快速Q学习)算法,该算法将径向基函数(RBF)神经网络与Q学习算法相结合,使用RBF代替Q表来逼近动作价值函数,提高了Q学习算法的收敛速度。

此外,为了保证规划的路径符合机动特性和稳定性,算法综合考虑了无人潜航器的航向角、角速度等指标,提出了安全阈值,并采用3阶贝塞尔曲线[86]平滑初始路径。仿真结果表明,NSFQ算法在航向角、角速度、路径长度、航行时间和路径平滑度等评价指标上优于A* 和RRT算法。

针对传统的DQN奖励函数可能导致模型的学习效率和收敛速度较低的问题,Guo等[87]对DQN算法的奖励函数进行了改进。从“设定目标点对船舶的势能奖励”“在目标点附近增加奖励区域”以及“在障碍物附近增加危险区域”3个方面来优化方法,船舶可以快速避开障碍物到达目标点。

与传统DQN、A*、BUG2和APF算法进行实验比较,在路径长度、规划时间和路径角数等方面,优化后的DQN算法具有更好的稳定性和收敛性,大大缩短了计算时间,提高了船舶航行的安全性、经济性和自主决策能力。但该算法没有考虑静态障碍物和动态障碍物同时存在的海洋环境。

针对一些传统路径规划法只适合离散环境的问题,Xiao等[88]提出了基于Beta策略的分布式采样PPO算法,该算法解决了全局路径规划任务中样本采集不平衡的问题,有效提高了算法的性能和鲁棒性。

此外,还使用Box2D物理引擎构建环境结构,实现了强化学习的连续状态空间和动作空间的环境设计[89]。改进算法比传统A*、Dijkstra算法生成的路径更加平滑,但没有在真实的海洋环境中进行测试,实际应用时性能可能会下降。

针对环境未知问题,Wang等[90]基于A3C局部路径规划算法,改进了状态空间、动作空间和奖励函数,使无人潜航器保持固定的纵向速度,并且输出的动作空间能够满足运动学约束。

该算法规划的路径耗时短,能够满足实时性规划的要求。与APF和遗传算法的对比结果表明,A3C算法可以在密集和不规则障碍物环境以及窄通道障碍物环境中规划出平滑的避碰路径。

4.1.7 搜索与救援

目前对建筑物火灾应急疏散能力的要求越来越高,然而,大多数规划是基于预先建立的静态疏散路线,未能考虑实时火灾场景的动态性。为此,Feng等[91]根据火灾场景的特点,在DDPG算法中引入了内在动机,增强了其对状态空间的探索能力,并采用HER策略提高了算法的训练效率。

针对强化学习中的超参数敏感性问题,采用鲸鱼优化算法[92]进行超参数优化,该模型可以从任意位置规划疏散路径,所规划的路径能有效平衡环境中的风险与距离成本。

Huang等[93]在DDPG算法的基础上提出了适用于火灾疏散的邻域多智能体深度确定性策略梯度(AMADDPG)模型,该模型考虑了拥挤程度和最近出口的影响,采用“分布式执行和集中式局部学习”的训练框架,实现相邻智能体之间的经验共享。

实验结果展示了无论有无火情,该算法在30 s内均能实现最优路径规划,疏散路径上的拥挤程度始终保持在0.5以内,同时,与MADDPG算法相比,AMADDPG算法的平均收敛迭代次数减少了26次,曲线波动明显小于MADDPG算法。但该模型尚未应用到实际火灾场景,泛化能力不强。

4.2 模拟环境

为了有效地开发和测试路径规划算法,研究人员和工程师通常依赖于各种模拟环境,这些模拟环境提供了可控的实验平台,用于验证和优化路径规划策略。本节将介绍一些常见的路径规划模拟环境,如Unity 3D[94]、高速公路仿真环境[95]、迷宫仿真环境[96]、2D网格环境[97]以及CARLA模拟器[98]等。

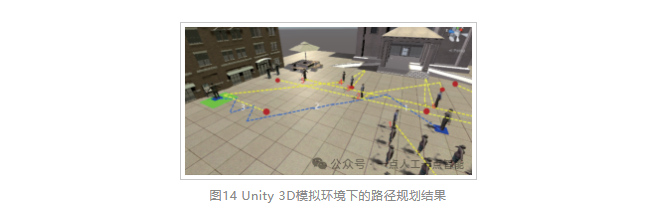

针对文[87] 未解决的静/动态混合避障问题,Xue等[99]提出了一种将模型预测控制(MPC)[100]与DDPG相结合的新算法,应用MPC算法预测动态障碍物的运动轨迹,其次,设计具有连续动作空间的DDPG算法,为机器人提供学习和自主决策的能力,此外,引入了人工势场的思想来设置奖励函数,以提高算法的收敛速度和精度,并在如图14所示的Unity 3D模拟环境中进行实验。与其他方法相比,该方法精度提高了7%~30%,路径长度和转弯角度分别比DQN算法减小了100个单位和400~450∘。  Liao等[101]采用对抗性DDQN算法,通过建立如图15所示的高速公路行驶环境,来解决高速公路上的超车行为。此外,还提出了一种分层控制框架,上层管理车辆的驾驶决策,下层负责监督车辆的速度和加速度。将所提算法与DQN算法进行了比较,证明了该算法在收敛速度以及超车安全性方面的优势,但是没有考虑硬件在环实验且没有与其他技术优化器进行比较。

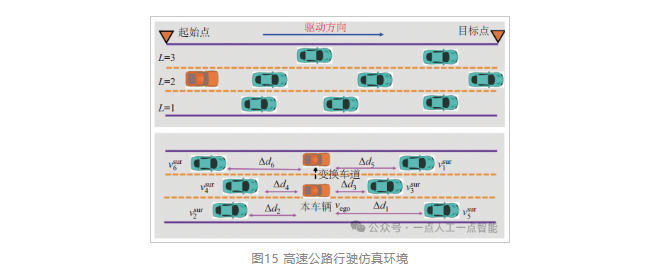

Liao等[101]采用对抗性DDQN算法,通过建立如图15所示的高速公路行驶环境,来解决高速公路上的超车行为。此外,还提出了一种分层控制框架,上层管理车辆的驾驶决策,下层负责监督车辆的速度和加速度。将所提算法与DQN算法进行了比较,证明了该算法在收敛速度以及超车安全性方面的优势,但是没有考虑硬件在环实验且没有与其他技术优化器进行比较。  王现磊等[102]提出了基于SARAS的优化算法(SA-SARAS),智能体在状态到动作的选择策略上,用模拟退火策略[103]替代ε贪婪策略,算法在前期模拟退火策略下搜索率高,之后随着退火冷却过程逐渐收敛。在如图16所示的迷宫仿真环境中与SARAS和Q学习算法进行对比实验,实验结果表明,改进算法的训练集减少了30个回合,此外,其在搜索效率和稳定性上都比另外2种算法效果好。

王现磊等[102]提出了基于SARAS的优化算法(SA-SARAS),智能体在状态到动作的选择策略上,用模拟退火策略[103]替代ε贪婪策略,算法在前期模拟退火策略下搜索率高,之后随着退火冷却过程逐渐收敛。在如图16所示的迷宫仿真环境中与SARAS和Q学习算法进行对比实验,实验结果表明,改进算法的训练集减少了30个回合,此外,其在搜索效率和稳定性上都比另外2种算法效果好。  Liao等[104]针对探索初期最佳动作利用率不高的问题,同样结合模拟退火策略提出改进的SARAS算法。在训练早期阶段,智能体随机选择动作,使其充分体验并探索那些最大Q值对应的动作,该算法可以有效地引导AGV(自动导引车)在如图17所示的2D网格图中规划最优路径,得到比原RL算法更好的解,但在10 000次训练之后,混合算法的最佳成功率仅达到88.62%。

Liao等[104]针对探索初期最佳动作利用率不高的问题,同样结合模拟退火策略提出改进的SARAS算法。在训练早期阶段,智能体随机选择动作,使其充分体验并探索那些最大Q值对应的动作,该算法可以有效地引导AGV(自动导引车)在如图17所示的2D网格图中规划最优路径,得到比原RL算法更好的解,但在10 000次训练之后,混合算法的最佳成功率仅达到88.62%。  Lee等[105]提出了一种基于A3C的双层多智能体系统,该系统通过分层表达2D网格空间并确定动作,减小了智能体需要考虑的状态空间。该方法不训练上层,只利用下层的学习值进行决策,将学习时间缩短到传统方法的1/13以内,仅为传统方法总学习量的7.1%。

Lee等[105]提出了一种基于A3C的双层多智能体系统,该系统通过分层表达2D网格空间并确定动作,减小了智能体需要考虑的状态空间。该方法不训练上层,只利用下层的学习值进行决策,将学习时间缩短到传统方法的1/13以内,仅为传统方法总学习量的7.1%。

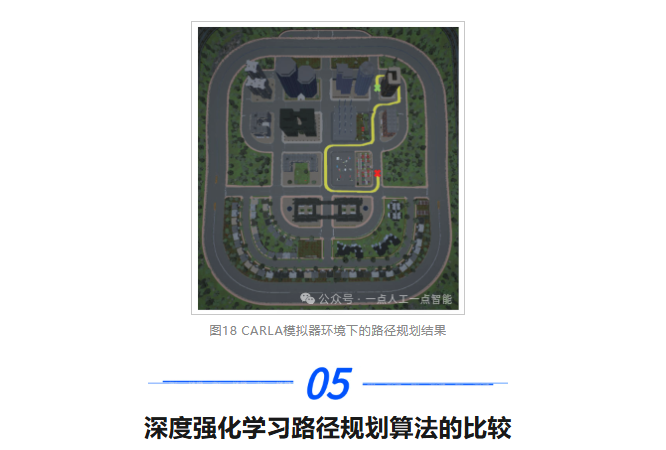

Yurtsever等[106]针对城市自动驾驶场景,提出了一种将路径规划器集成到基于视觉的DRL框架中的混合方法——Hybrid DQN,根据偏离路径规划器的惩罚和发生碰撞的惩罚来改进奖励函数。改进方法能够在如图18所示的动态城市仿真环境CARLA中进行路径规划,性能远高于传统DQN算法,但该方法仅限输出离散化的动作,并未实现持续控制以及在真实世界进行测试。  5.1 算法性能评价指标

5.1 算法性能评价指标

为了全面、准确地评估算法在路径规划任务中的表现,采用了一系列性能评价指标,它不仅有助于理解和比较不同算法的优劣,还能为算法的选择、优化和实际应用提供重要参考,以下列举了4种常见的性能评价指标。

1) 成功率:衡量算法在给定任务中完成目标能力的最直接指标。它通常定义为算法在多次尝试中成功完成任务的百分比。高成功率意味着算法具有较高的稳定性和可靠性。

2) 路径长度:算法从起点到终点所规划出的路径的总长度。较短的路径长度意味着算法能够更高效地完成任务,减少不必要的移动和能量消耗。

3) 奖励回报:环境根据智能体所采取的行动给予的一种即时反馈。这种反馈机制通常采用数值表达,可以是正数、负数或0,用来表示该行动对于实现目标是有益的、有害的还是中性的,智能体的目标就是最大化其从环境中获得的累计奖励回报。

4) 收敛时间:反映了算法在生成规划结果或作出决策时的速度。在实时性要求较高的任务中,收敛时间成为衡量算法性能的关键指标。较短的收敛时间意味着算法能够更快地响应环境变化,提高系统的整体效率。

5.2 不同算法的性能对比

选择深度强化学习的三大类方法中的代表性算法——DQN、PPO和A2C,并在传统算法中选取A* 算法进行实际对比分析。首先,创建一个自定义的Gym环境来模拟智能体的运动。该环境满足方法所要的条件,例如初始化函数reset() 和执行一个动作回合函数step(),并定义了状态和动作空间。

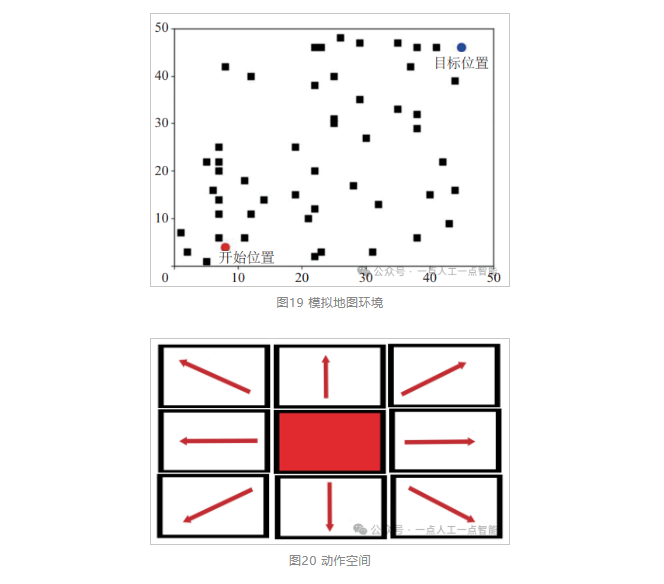

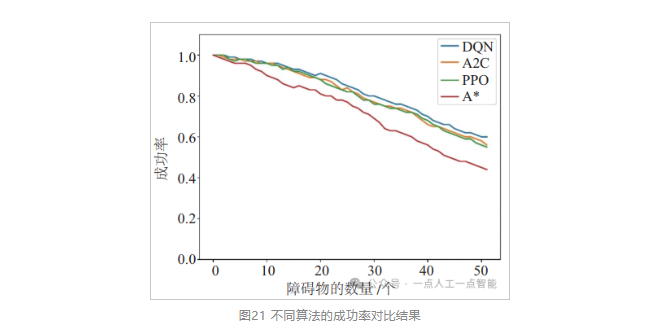

模拟实验的状态信息如图19所示,采用50 cm×50 cm的网格,其中每个单位表示1 cm,在地图上随机生成障碍物,并用黑色方块表示。动作空间包括8个离散方向的动作,如图20所示。4种算法分别进行了1 000次测试,每次迭代步数限制为200步。如果在200步内未能到达目标位置,则该测试被视为失败。比较的性能指标包括成功率、路径规划长度、奖励回报和收敛时间。  在成功率方面,图21给出了4种算法在不同障碍物数量下的对比结果。每种算法在无障碍物的情况下成功率均达到了100%,随着障碍物数量的增多,A* 算法性能迅速下降,而DQN算法表现最优越,特别是在障碍物数量增多的情况下,其成功率始终保持在较高水平。

在成功率方面,图21给出了4种算法在不同障碍物数量下的对比结果。每种算法在无障碍物的情况下成功率均达到了100%,随着障碍物数量的增多,A* 算法性能迅速下降,而DQN算法表现最优越,特别是在障碍物数量增多的情况下,其成功率始终保持在较高水平。  在路径规划的平均长度方面,当起点和终点的位置相同且障碍物数量为40时,A*、DQN、PPO和A2C算法获得的平均路径长度分别为37.427、24.331、23.639和35.338 cm。可以看出PPO算法在障碍物密集的环境中的路径规划长度较短,表明它在动态调整和优化路径选择方面具有较强的能力,而A* 算法由于启发式搜索的局限性,生成的路径往往较长。

在路径规划的平均长度方面,当起点和终点的位置相同且障碍物数量为40时,A*、DQN、PPO和A2C算法获得的平均路径长度分别为37.427、24.331、23.639和35.338 cm。可以看出PPO算法在障碍物密集的环境中的路径规划长度较短,表明它在动态调整和优化路径选择方面具有较强的能力,而A* 算法由于启发式搜索的局限性,生成的路径往往较长。

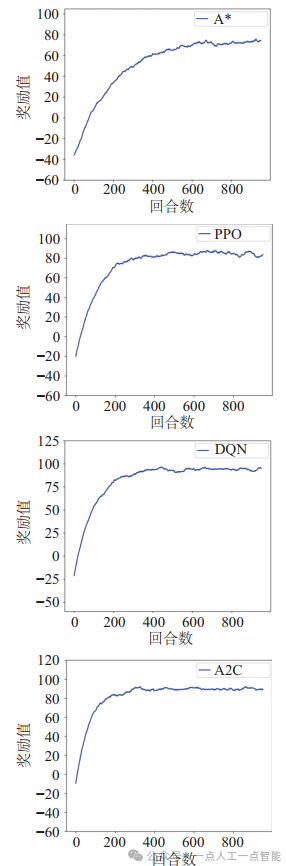

在奖励回报和收敛时间方面,对A* 算法也引入奖励惩罚机制,到达目标位置时奖励值加5,碰到障碍物时奖励值减2,否则,根据智能体与目标位置的欧几里得距离(L2距离)给予一个负的奖励值。

图22给出了4种算法训练1 000个回合的对比结果,从实验结果可以看出3种强化学习算法在收敛到最优解时奖励回报均高于A* 算法,其中DQN算法表现最为突出。在收敛时间方面,A2C算法训练不到200个回合就可以收敛到最优解,相对其他算法表现更优。

图22 不同算法的奖励回报对比结果

从上述结果来看,深度强化学习算法在多个性能指标上都优于传统的A* 算法,尤其是在处理障碍物较多的环境时。基于值的DQN算法可以重用先前的经验来加速学习过程,能够较好地评估每个状态下的最佳动作,更好地适应复杂的奖励惩罚机制,从而提高成功率。基于策略的PPO算法通过策略网络的直接优化,提高了算法在路径规划方面的能力,通常能够规划出更短且更高效的路径。

值策略混合A2C算法能够综合考虑状态评估和行动选择,凭借其并行化训练的特性,在多核处理器上实现了高效的并行计算,从而大大加快了训练速度,尤其适合于需要快速响应和高效决策的场景。总之,选择合适的强化学习算法应综合考量具体问题的特点、环境的复杂度以及性能需求。  目前,基于深度强化学习的路径规划方法仍然面临很多挑战。这些挑战源于算法本身的特点以及外部环境。下面主要分析和总结这些挑战,然后结合这些分析,对未来的研究方向进行展望。

目前,基于深度强化学习的路径规划方法仍然面临很多挑战。这些挑战源于算法本身的特点以及外部环境。下面主要分析和总结这些挑战,然后结合这些分析,对未来的研究方向进行展望。

1) 样本采样效率低。深度强化学习在路径规划领域的应用高度依赖于充足的训练数据以进行有效的学习和优化。例如文[79] 需要大量的训练样本才能训练出有效的策略,然而,采集并标注大规模的路径规划数据是一项既昂贵又耗时的任务,这在实际应用中可能不切实际。

2) 实时决策能力有限。在动态环境中,路径规划问题变得更加复杂,因为障碍物和约束条件可能随时发生变化,DRL算法需要能够在这种环境下作出实时决策,以确保路径规划的有效性和安全性。然而,很多算法存在实时性不足的问题,例如文[71] 等都未考虑算法的实时性,这可能导致路径规划无法适应环境的快速变化,从而影响整体性能和任务的完成度。

3) 稀疏奖励和训练效率低下。奖励函数的设计对于引导智能体学习正确的行为至关重要,然而,在实际应用中,奖励往往是稀疏的,即智能体在大多数时间步中都无法获得奖励信号,这会导致训练效率低下,因为智能体需要花费大量时间来探索环境并找到能够获得奖励的行为。

4) 安全性和稳定性挑战问题。在自动驾驶等应用领域中,路径规划问题对安全性和稳定性有着极高的要求。而在文[82,85] 等的研究中,训练过程存在不稳定的情况,路径可能频繁变化或偏离目标,导致车辆失控或与其他障碍物发生碰撞。

根据以上对DRL算法面临挑战的分析,未来规划算法的发展目标具体可归纳为以下4个方面:

1) 提高数据采集与利用的效率。利用先进的模拟环境生成多样化的训练样本以减少对真实数据的依赖。同时,探索主动学习策略,如基于不确定性和多样性的采样,以优化样本选择,提升利用效率。此外,研究还可以关注数据复用机制,如利用GAN进行数据增强,以及使用迁移学习和元学习等技术,加速学习过程并降低对新样本的需求。

2) 设计轻量级、高效的神经网络模型。通过剪枝、量化等技术缩减模型体积,提升推理速度。同时,探索在线学习、增量学习等快速适应机制,使模型能实时更新并积累新知识。此外,还可以利用并行与分布式计算技术,如GPU并行计算、分布式训练等,加速模型训练和推理,以应对复杂环境的挑战。

3) 优化奖励塑形与内在动机机制。奖励塑形可以通过添加中间奖励、设计形状奖励等方式来引导智能体朝着目标前进,内在动机机制可以通过鼓励智能体探索未知区域、尝试新行为等方式来提高其学习动力。分层强化学习也是提高训练效率的重要方法,通过将复杂的路径规划任务分解为多个子任务,并为每个子任务设计单独的奖励函数,来简化学习过程并提高训练效率。同时,还可以结合无模型强化学习与模仿学习的方法,利用专家示范数据来引导智能体的学习行为、加快收敛速度。

4) 引入安全性约束与提高鲁棒性。在路径规划过程中引入安全性约束条件,如基于安全性的损失函数设计和策略优化等,同时还需提高模型对噪声和扰动的鲁棒性。利用形式化验证和模型检查技术对路径规划方案进行安全性评估,提前发现并避免潜在的危险情况。  全面探讨了路径规划问题中传统算法的基本原理及其实际应用表现,并引入了深度强化学习算法作为解决该问题的新思路,重点关注基于价值函数、策略以及值策略混合这3种基本类型。针对每种算法,详细分析了它们在不同应用领域中的优势与局限,并选用代表性算法在统一平台上进行测试,进一步揭示了每种算法的适用场景与独特价值。

全面探讨了路径规划问题中传统算法的基本原理及其实际应用表现,并引入了深度强化学习算法作为解决该问题的新思路,重点关注基于价值函数、策略以及值策略混合这3种基本类型。针对每种算法,详细分析了它们在不同应用领域中的优势与局限,并选用代表性算法在统一平台上进行测试,进一步揭示了每种算法的适用场景与独特价值。

尽管已有许多代表性的研究工作展示了深度强化学习在路径规划领域的潜力,但该类算法在实际应用中仍面临一系列挑战,基于这些挑战及当前的研究趋势,预测了基于深度强化学习的路径规划方法的未来研究方向,旨在为相关领域的研究与实践提供有益的参考与指导。